사진 올리면 자동으로 누드 사진으로 바꿔주는 AI봇 만든 변태남

AI챗봇 '이루다'의 서비스가 중단된 가운데 딥페이크 기술을 이용해 누드 사진을 만드는 AI봇이 논란이다.

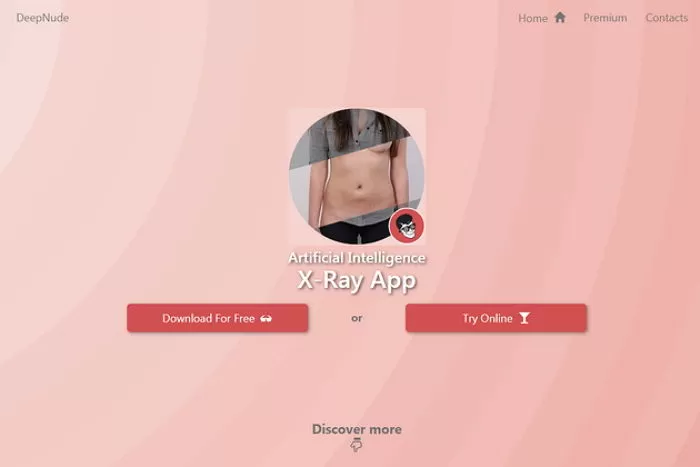

DeepNude로 만든 누드 사진 / DeepNude

DeepNude로 만든 누드 사진 / DeepNude

[인사이트] 김다솜 기자 = 인공지능(AI) 챗봇 '이루다'가 소수자에 대한 혐오 발언 및 개인정보 유출 등의 논란에 휩싸였다.

'딥러닝 기술(Deep Learning)'을 이용한 AI챗봇으로 '진짜 사람' 같은 채팅으로 인기를 끌었지만 이루다를 둘러싼 성희롱 논란 등의 문제가 나타난 것이다.

이에 한 프로그래머가 AI를 활용해 누드 사진을 만든 AI봇이 재조명되고 있다.

지난 11일(현지 시간) 베트남 매체 '어패밀리(afamily)'는 프로그래머가 개발한 'DeepNude' 앱을 고발했다.

DeepNude로 만든 누드 사진 / DeepNude

DeepNude로 만든 누드 사진 / DeepNude

DeepNude 앱은 인공지능(AI)을 이용해 여성의 사진을 자동으로 '누드 사진'처럼 바꾼다.

원하는 사진, 원하는 부분을 잘라 입력하기만 하면 상의, 속옷 등 전부 벗겨 노출을 시키는 것이다.

이 앱은 무료, 유료 버전으로 등장했다. 무료 버전은 워터마크 표시가 있지만, 유료 버전은 '거짓'임을 알 수 있는 워터마크도 없다.

DeepNude

DeepNude

또 앱은 현재 여성 사진에만 사용할 수 있게 해 성차별 논란을 일으키기도 했다.

매우 정교한 딥페이크 기술이 보급되기 시작하면서 가짜뉴스, 음란물 등에 악용될 수 있는 우려도 점차 커지고 있는 상황.

딥페이크의 역기능을 막기 위한 확실한 조처가 필요해 보이는 가운데 논란이 어떻게 이어질지, 사그라질지 귀추가 주목된다.